Tra l'8 e l'11 aprile 2026, nel cuore della Pavia Innovation Week, si è svolto un esperimento giuridico senza precedenti: mettere sotto processo l’intelligenza artificiale. Non una metafora, ma una simulazione processuale con avvocati, testimoni e un'aula vera, dove algoritmi e decisioni automatizzate sono stati sottoposti al vaglio del diritto. L'iniziativa evidenzia una tensione crescente nei sistemi giuridici occidentali: come attribuire responsabilità quando le azioni derivano da codice informatico, non da volontà umana diretta?

La domanda non è accademica. Nel 2024, il Regolamento europeo sull'intelligenza artificiale (AI Act) ha introdotto categorie di rischio per i sistemi automatizzati, imponendo obblighi di trasparenza e tracciabilità. Ma la norma non risolve il nodo della responsabilità penale. Un algoritmo può essere imputato? O la colpa ricade sempre su chi lo programma, lo addestra, lo distribuisce? Il processo simulato di Pavia ha messo in scena proprio questa ambiguità, sollevando dubbi che attraversano tre continenti.

La frammentazione normativa tra Europa e Stati Uniti

Mentre l'Unione Europea punta su regolamentazione ex ante — vietando applicazioni ad alto rischio come il riconoscimento facciale indiscriminato o i sistemi di credito sociale — gli Stati Uniti mantengono un approccio settoriale. California e New York hanno introdotto leggi sulla trasparenza algoritmica nei processi di assunzione e nei prestiti bancari, ma manca una cornice federale. In Cina, il governo impone audit governativi sugli algoritmi di raccomandazione dal 2022, privilegiando il controllo statale sulla tutela individuale.

Il risultato è un mosaico di giurisdizioni incompatibili. Un'azienda tecnologica può addestrare un modello di machine learning in California, distribuirlo in Europa e utilizzarlo per decisioni creditizie in Asia, ciascuna con standard di responsabilità diversi. Il caso del 2023 contro una piattaforma di recruiting accusata di discriminazione di genere ha coinvolto tre ordinamenti giuridici simultaneamente, senza che nessuno riuscisse a identificare un responsabile univoco. Il codice era stato scritto da contractor esterni in India, addestrato su dati statunitensi, impiegato da una multinazionale olandese.

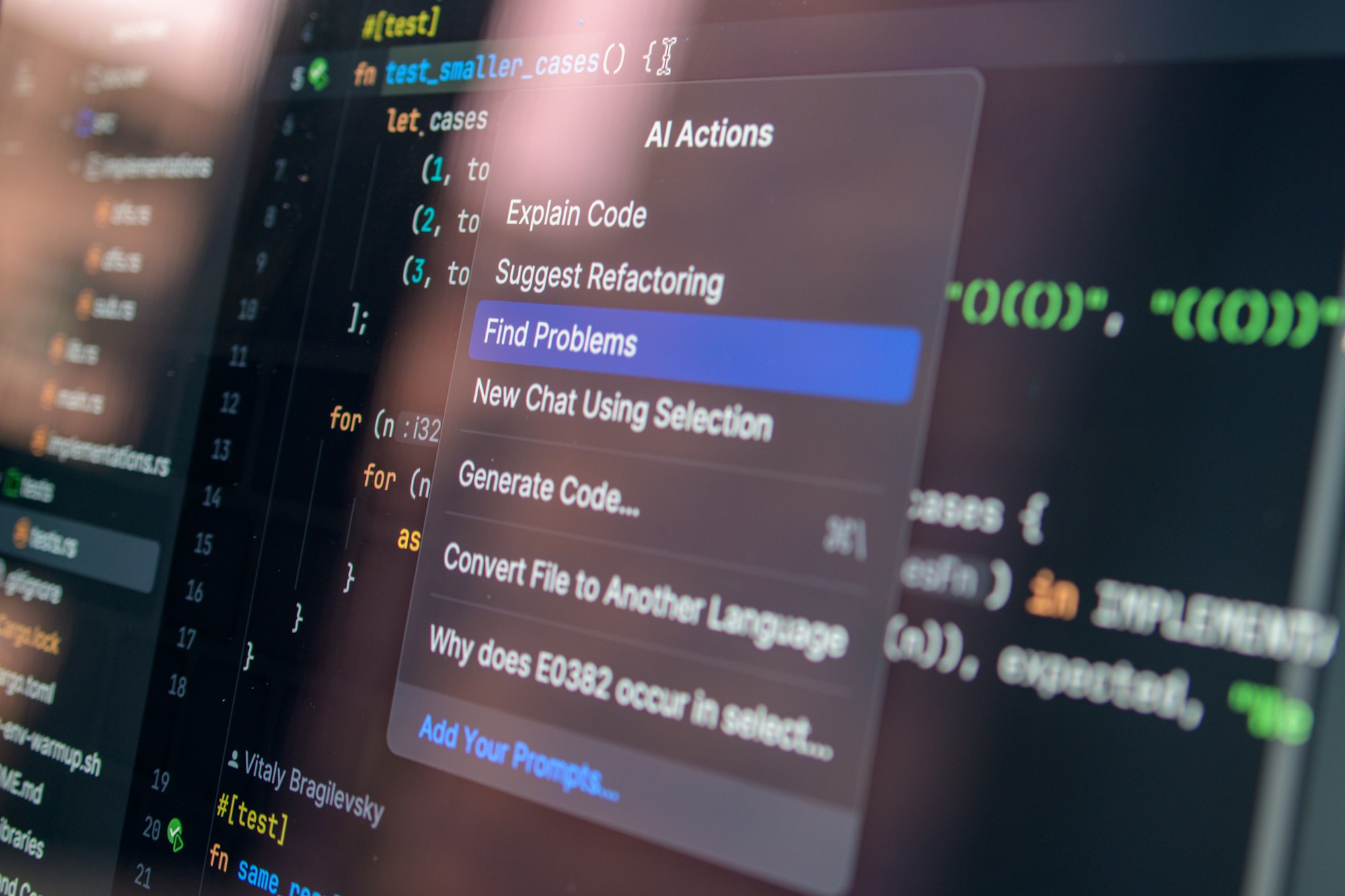

Il video qui sopra documenta l'esperimento giuridico tenutosi a Pavia: un processo simulato all'IA che, come evidenziato dal Corriere della Sera, solleva dubbi che attraversano tre continenti.

Chi risponde quando l'algoritmo sbaglia

Il dibattito giuridico si concentra su tre modelli di responsabilità. Il primo, detto «della trasparenza», obbliga chi sviluppa o impiega sistemi di IA a documentare ogni passaggio decisionale. Il secondo, «della custodia», assimila l'algoritmo a uno strumento pericoloso: chi lo possiede ne risponde oggettivamente, come per un animale domestico. Il terzo, più radicale, propone la personalità giuridica per i sistemi autonomi, con patrimoni separati e capacità processuale limitata.

Nessuno di tali modelli è stato ancora adottato pienamente. In Italia, il Codice Civile riconosce responsabilità extracontrattuale per chi esercita attività pericolose, ma la giurisprududenza non ha mai applicato la norma a decisioni algoritmiche. Nel Regno Unito, dopo la Brexit, si discute di una «strict liability» per i sistemi ad alto rischio, ma il testo legislativo è ancora in consultazione. Intanto, i danni si accumulano: errori diagnostici in ambito sanitario, decisioni di credito discriminatorie, sentenze giudiziarie basate su software di risk assessment mai verificati.

Il processo simulato di Pavia ha ricostruito un caso reale: un algoritmo di valutazione del rischio recidiva utilizzato in tribunale aveva classificato erroneamente un imputato come ad alta pericolosità, influenzando la decisione del giudice sulla custodia cautelare. Chi doveva rispondere? Lo sviluppatore del software, venduto come «black box» senza documentazione? Il tribunale che lo aveva adottato senza verifiche? Il giudice che aveva basato la propria decisione sui punteggi automatici? La difesa ha sollevato un'obiezione: l'algoritmo aveva agito secondo i parametri stabiliti, ma tali parametri riflettevano pregiudizi statistici impliciti nei dati di addestramento, raccolti in un contesto sociale diseguale.

Le domande de l'Analista

Se un sistema di intelligenza artificiale produce un danno seguendo le istruzioni per cui è stato progettato, ma applicandole in modo tecnicamente corretto su dati viziati, dove si colloca la responsabilità giuridica: nell'algoritmo, nei dati, o nella società che ha generato quelle disuguaglianze?

In un mercato globale dove codice, dati e decisioni attraversano confini senza sosta, è ancora sostenibile un sistema di responsabilità basato su giurisdizioni nazionali separate, o serve un tribunale internazionale dedicato ai conflitti algoritmici?